Unreal Engine Demo Reel - Next-Gen Visuals

Полная версия этой страницы: Техно-демо и графика в реальном времени

CryEngine NextGen Tech Demo (Gamescom 2013)

CryEngine Licensee Trailer

Unity Engine - Photorealistic Characters

Девушки хороши

Что-то очень сильно реалистично

Интересно как эти модельки себя поведут, если к ним приделать анимацию.

Интересно как эти модельки себя поведут, если к ним приделать анимацию.

Если мне глаза не врали то в некоторых кадрах когда совсем близко камеру подкатывают видно что анимация дыхания есть, т.е. грудная клетка шевелится(скорее всего сильно ошибаюсь и это обман зрения). А вообще для таких моделей надо комбинировать сразу 2 типа анимаций, скелетную для общей картины и морфинговую по верх с деталями мелкими. Интересно на каком железе все это отработало в ролике.

На конференции графических дизайнеров SIGGRAPH 2013 было представлено новое программное обеспечение, которое делает из фотографии 3D-объект.

BeamNG - 1977 Bruckell Moonhawk

Unreal Engine 4 Character Aesthetics Video

И толку от этих всех плюшек ? Все равно в играх не используют

RusStarik, для этого nVidia совсем не нужна)

RusStarik, все равно монитор на ощупь плоский  А применяют некую эмуляцию везде, даже на танцовщицах в Last Light

А применяют некую эмуляцию везде, даже на танцовщицах в Last Light

О, ну наконец-то додумались использовать сотни гигафлопсов для просчета GI. Так странно объясняет, как-будто люди совершенно не знакомы с физикой, и в жизни у нас нет такого понятия как отраженный свет.  Интересно, сколько мощности ещё на это требуется.

Интересно, сколько мощности ещё на это требуется.

Огонь хорош, но по сути это всё тот же дым, который сделали лет 8 назад...

Огонь хорош, но по сути это всё тот же дым, который сделали лет 8 назад...

Unreal Engine 4 - Visual Effects

Brigade 3 real-time path tracing

New real-time CUDA path tracer Arauna 2 announced

New Arauna2 engine

(скачать демку) http://mega.co.nz/#!UphmTTxb!JAfhjCfDa3-zDo3Zy5gD9EArYxlkJKa10XPqZY8sZRs

(Unity Engine - Photorealistic Characters)

Моя 640-ая кушала эту демку с удовольствием(конечно, все относительно. ) Демка в открытом доступе, можно поискать на сайте разработчика. Я тестировал для "окулуса рифта". Демка просто супер, как живые, есть одно "но" - глаза моделей мертвые...

) Демка в открытом доступе, можно поискать на сайте разработчика. Я тестировал для "окулуса рифта". Демка просто супер, как живые, есть одно "но" - глаза моделей мертвые...

Кстати, в Star Citizen взяли на вооружение эту технологию.

New real-time CUDA path tracer Arauna 2 announced

New Arauna2 engine

(скачать демку) http://mega.co.nz/#!UphmTTxb!JAfhjCfDa3-zDo3Zy5gD9EArYxlkJKa10XPqZY8sZRs

Цитата(jamakasi)

Интересно на каком железе все это отработало в ролике.

(Unity Engine - Photorealistic Characters)

Моя 640-ая кушала эту демку с удовольствием(конечно, все относительно.

Кстати, в Star Citizen взяли на вооружение эту технологию.

Цитата

(Unity Engine - Photorealistic Characters)

Моя 640-ая кушала эту демку с удовольствием(конечно, все относительно. biggrin.gif) Демка в открытом доступе, можно поискать на сайте разработчика. Я тестировал для "окулуса рифта". Демка просто супер, как живые, есть одно "но" - глаза моделей мертвые... z_crazy.gif

Моя 640-ая кушала эту демку с удовольствием(конечно, все относительно. biggrin.gif) Демка в открытом доступе, можно поискать на сайте разработчика. Я тестировал для "окулуса рифта". Демка просто супер, как живые, есть одно "но" - глаза моделей мертвые... z_crazy.gif

Скинь пожалуйста ссыль на сайт разрабов а еще лучше сразу на загрузку демки, искал битый час и ничего кроме видео и вах вах возгласов не нашел

Это матрица. Графика уже кинофильма.

Класс! Вот это фотореализм!

<font size="3">Unity Engine - Photorealistic Characters</font>

<iframe src="//player.vimeo.com/video/73422331?autoplay=0" width="560" height="315" frameborder="0" webkitallowfullscreen mozallowfullscreen allowfullscreen></iframe>

<iframe src="//player.vimeo.com/video/73422331?autoplay=0" width="560" height="315" frameborder="0" webkitallowfullscreen mozallowfullscreen allowfullscreen></iframe>

Класс! Вот это фотореализм!

Цитата(jamakasi)

Скинь пожалуйста ссыль на сайт разрабов а еще лучше сразу на загрузку демки, искал битый час и ничего кроме видео и вах вах возгласов не нашел

Сорри, не помню где скачал....вот сайт

Можно попробовать скачать другую демку, но у меня она лагает слишком сильно, не оптимизирована....плюс она для "окулуса рифта" с разделенным экраном...можно покопаться настройках.....

Тестировал другую демку на "OR" и без - все супер.

(Внимание!!! Детям не показывай....+18... и взрослым тоже...уж больно некрасивая порноак....ой, модель...

Скачать можно тут:

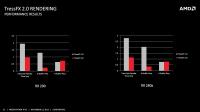

AMD представила TressFX 2.0

AMD Gaming EvolvedВ начале года AMD представила технологию TressFX, обеспечивающую динамическую симуляцию волос. Первой и единственной пока что игрой с поддержкой TressFX стала Tomb Raider. На конференции APU14 теперь было представлено второе технологии, которая станет не только более реалистичной и сложной, но и обеспечит рендеринг других объектов, таких как трава. В технологии TressFX 1.0 уже использовались структуры данных Per Pixel Linked List (PPLL), кторые позволяли оптимизировать рендеринг и использование памяти. Расчет физики волос выполнялся через DirectCompute. Соответственно, разработчики игр могли просчитывать влияние на волосы гравитации, движения или ветра. Также индивидуально рассчитывалось освещение каждой пряди волос, что тоже добавляло реалистичности.

С технологией TressFX 2.0 AMD сделала ещё шаг вперёд, добавив к A-буфера ещё и K-буфер. A-буфер отвечает за рендеринг каждого волоса. При этом учитывается сглаживание, вершинные и пиксельные шейдеры, каждая секция волоса содержит информацию о длине волоса, перекрывается он или нет, контактирует ли он с другими волосами или нет, а также указывает на следующую секцию. K-буфер добавляет новую информацию. Он позволяет выполнять боле реалистичное освещение, так как свет и тени могут рассчитываться отдельно для каждого волоса. Прозрачные волосы, перекрывающие друг друга, будут пропускать меньше света, что тоже учитывается. Вся эта информация может учитываться в K-буфере.

Чтобы улучшить производительность, TressFX 2.0 позволяет уменьшить количество прядей волос в зависимости от расстояния до зрителя. Уровень детализации Level Of Detail (LOD) позволяет симулировать толстые волосы, что позволяет легко представить отдельные толстые волосы вместо отсутствующих прядей.

В собственных тестах AMD показана разница между TressFX 1.0 и 2.0 на видеокартах Radeon R9 290 и R9 280X. На GPU "Hawaii" с архитектурой GCN 2.0 (Radeon R9 290) общее время рендеринга уменьшилось с двух до одной миллисекунды. Проход A-буфера выполняется за 1,3 мс в первой версии TressFX, но в случае 2.0 - уже меньше чем за 0,3 мс. Зато время рендеринга с K-буфером увеличилось с 0,6 до 0,7 мс. Что касается видеокарты Radeon R9 280X, которая базируется на архитектуре GCN 1.0, время рендеринга уменьшилось с 2,7 до 1,1 мс. Проход A-буфера выполняется за 0,4 вместо 2 мс. У K-буфера мы получили ещё меньшие отличия.

Пока неизвестно, в каких играх появится поддержка TressFX 2.0.

Flex: Unified GPU PhysX - Teaser Trailer

Мили Маклин, программист физики nVidia и ведущий разработчик FLEX системы, ответил на несколько вопросов, касательно этой многообещающей технологии.

В: Что же такое nVidia - FLEX и для чего он нужен?

О: При создании набора функций FLEX мы в большой степени вдохновлялись такими инструментами, как Maya’s nCloth и Softimage Lagoa. Наша цель - принести возможности этих автономных приложений в игры в режиме реального времени.

FLEX был создан, что симулировать следующие элементы:

- Жидкости;

- Гранулы различных материалов (песок, грязь);

- Различные типы тканей (флаги, газеты);

- Твердые тела (осколки);

- Мягкие тела.

Мы используем единый интерфейс для всего этого, поэтому вы сможете комбинировать все эти элементы.

В: Является ли FLEX чисто GPU-ускоренной библиотекой, или она так же может обрабатываться CPU?

О: Сейчас у мы планируем реализацию на CUDA и DirectCompute. Мы рассматриваем обработку с помощью CPU. Кроме того FLEX прекрасно работает и на Linux (Ubuntu 12.04 64bit), в некоторых случаях даже быстрее чем в Windows.

В: Планируете ли вы выпустить FLEX для сторонних разработчиков? Вы собираетесь включить FLEX в PhysX SDK или APEX, или эти инструменты будут доступны в качестве самостоятельных SDK?

О: Сначала FLEX будет доступен в виде автономного SDK, который можно будет использовать вместе с PhysX 3.3.x, а позднее FLEX станет первоклассной особенностью PhysX 3.4.

Мили Маклин: Я часто говорю, что FLEX является низкоуровневой библиотекой, потому что основной интерфейс очень минималистичный. Таким образом, пользователи, которые захотят воспользоваться им, смогут вставить его в свои приложения и создать на этой основе свои инструменты, или же они могут использовать разработанные нами средства внутри PhysX / APEX.

В: Что же такое nVidia - FLEX и для чего он нужен?

О: При создании набора функций FLEX мы в большой степени вдохновлялись такими инструментами, как Maya’s nCloth и Softimage Lagoa. Наша цель - принести возможности этих автономных приложений в игры в режиме реального времени.

FLEX был создан, что симулировать следующие элементы:

- Жидкости;

- Гранулы различных материалов (песок, грязь);

- Различные типы тканей (флаги, газеты);

- Твердые тела (осколки);

- Мягкие тела.

Мы используем единый интерфейс для всего этого, поэтому вы сможете комбинировать все эти элементы.

В: Является ли FLEX чисто GPU-ускоренной библиотекой, или она так же может обрабатываться CPU?

О: Сейчас у мы планируем реализацию на CUDA и DirectCompute. Мы рассматриваем обработку с помощью CPU. Кроме того FLEX прекрасно работает и на Linux (Ubuntu 12.04 64bit), в некоторых случаях даже быстрее чем в Windows.

В: Планируете ли вы выпустить FLEX для сторонних разработчиков? Вы собираетесь включить FLEX в PhysX SDK или APEX, или эти инструменты будут доступны в качестве самостоятельных SDK?

О: Сначала FLEX будет доступен в виде автономного SDK, который можно будет использовать вместе с PhysX 3.3.x, а позднее FLEX станет первоклассной особенностью PhysX 3.4.

Мили Маклин: Я часто говорю, что FLEX является низкоуровневой библиотекой, потому что основной интерфейс очень минималистичный. Таким образом, пользователи, которые захотят воспользоваться им, смогут вставить его в свои приложения и создать на этой основе свои инструменты, или же они могут использовать разработанные нами средства внутри PhysX / APEX.

|

Agni's Philosophy на планшете при помощи Project Flare

Character Demo

Flying Demo

Character Demo

Flying Demo

Project Flare - облачная технология в действии.

refuse,

Мой пост только для внесения ясности, обработкой картинки занимается не железо планшета.

Мой пост только для внесения ясности, обработкой картинки занимается не железо планшета.

Цитата(GameTech.ru)

Компания Square Enix официально сообщила о том, что она занимается созданием новой архитектуры для Cloud-гейминга, которая получила название Project Flare. Издатель сразу предупредил, что до запуска Project Flare остается еще 2-3 года.

Project Flare использует множество серверов, связанных между собой в виртуальный суперкомпьютер, который используется для всевозможных просчетов. Это, по мнению Square Enix, должно произвести ревлюцию в том, как пользователи взаимодействуют с игровыми мирами.

Представитель Square Enix Джейкоб Навок (Jacob Navok) в интервью Polygon заявил, что они использует не такой подход, как Gaikai и OnLive.

«Сегодня, когда мы говорим о Cloud-играх, речь идет о стриминге контента, но мы не считаем это революцией. Да, Gaikai, OnLive и прочие изменили модель дистрибуции, однако эти решения не позволяют произвести радикальные изменения в игровом дизайне, в используемых технологиях».

Project Flare использует множество серверов, связанных между собой в виртуальный суперкомпьютер, который используется для всевозможных просчетов. Это, по мнению Square Enix, должно произвести ревлюцию в том, как пользователи взаимодействуют с игровыми мирами.

Представитель Square Enix Джейкоб Навок (Jacob Navok) в интервью Polygon заявил, что они использует не такой подход, как Gaikai и OnLive.

«Сегодня, когда мы говорим о Cloud-играх, речь идет о стриминге контента, но мы не считаем это революцией. Да, Gaikai, OnLive и прочие изменили модель дистрибуции, однако эти решения не позволяют произвести радикальные изменения в игровом дизайне, в используемых технологиях».

refuse

Она не только для планшетов, но и для прочих систем. Просто показали что и на планшете может работать.

(, .)

Она не только для планшетов, но и для прочих систем. Просто показали что и на планшете может работать.

Более-менее вменяемое объяснение, наверно

По его словам современные cloud-технологии это обыкновенный стриминг игр, и ничего больше. Компания Square Enix всегда придерживалась того что мнения что игры от сервисов OnLive и Gaikai ни в коей мере нельзя назвать облачными, ведь эти компания просто помещают игровые консоли в свой вычислительный центр, так что концептуально ничего не изменилось. Возможно им удалось добиться определённых сдвигов в областях бизнес-политики и дистрибуции, но ведь геймдизайн абсолютно не изменился.

Что же касается самого издательства, то значительная часть компании Square Enix брошена на создание уникальной "облачной" архитектуры, с помощью который можно практически полностью изменить концепцию игр, а также подход к их созданию.

Возьмём для примера консоли и мобильные устройства, которые рано или поздно устаревают из-за установленного в них железа, и последнее значительно сковывает фантазии и идеи разработчиков, так что им приходится прибегать к многочисленным компромиссам. Нэвок же утверждает что с помощью Project Flare данная проблема будет решена.

Описанный во время анонса алгоритм "облака" частично напоминает алгоритмы Microsoft, которые получат своё применение в Xbox One. Компьютер, игровая консоль и практически любое игровое устройство будет проводить рендеринг своими силами, но также присутствует возможность перебросить часть вычислений на удаленный сервер/сервера. Как уверяет Square Enix, таким образом можно открыть море безграничных возможностей для разработчиков.

Square Enix никогда не славилась как голословная компания, так что они решили продемонстрировать журналистам из Polygon пару роликов, которые и отражали суть и принципы их технологии. Первый был создан на основе популярной Deus Ex: Human Revolution, где журналисты могли наблюдать как мощный взрыв "разбросал" целую гору обыкновенных коробов. Что самое примечательное, они "летали и падали" соответствуя всем законам дядюшки Ньютона, а проседания FPS практически не наблюдалось, так как физика обрабатывалась с помощью технологии Project Flare.

А вот вторая техническая демка оказалась значительно веселее. На этот раз разработчики использовали для наглядной демонстрации игру Final Fantasy 11, в которую умудрились впихнуть режим "картинка в картинке", и теперь можно было наблюдать сразу за четырьмя персонажами в различных окошках выводимых на экран. Причём всё это производилось в режиме реального времени. Возможно Square Enix как бы намекнула, что их технология настолько хороша, что её можно было бы использовать даже в GTA 5. И ведь действительно, в GTA 5 можно было бы переключаться между персонажами в считанные мгновения, вне зависимости от того в каких Лос-Сантоса они находятся.

Что же касается самого издательства, то значительная часть компании Square Enix брошена на создание уникальной "облачной" архитектуры, с помощью который можно практически полностью изменить концепцию игр, а также подход к их созданию.

Возьмём для примера консоли и мобильные устройства, которые рано или поздно устаревают из-за установленного в них железа, и последнее значительно сковывает фантазии и идеи разработчиков, так что им приходится прибегать к многочисленным компромиссам. Нэвок же утверждает что с помощью Project Flare данная проблема будет решена.

Описанный во время анонса алгоритм "облака" частично напоминает алгоритмы Microsoft, которые получат своё применение в Xbox One. Компьютер, игровая консоль и практически любое игровое устройство будет проводить рендеринг своими силами, но также присутствует возможность перебросить часть вычислений на удаленный сервер/сервера. Как уверяет Square Enix, таким образом можно открыть море безграничных возможностей для разработчиков.

Square Enix никогда не славилась как голословная компания, так что они решили продемонстрировать журналистам из Polygon пару роликов, которые и отражали суть и принципы их технологии. Первый был создан на основе популярной Deus Ex: Human Revolution, где журналисты могли наблюдать как мощный взрыв "разбросал" целую гору обыкновенных коробов. Что самое примечательное, они "летали и падали" соответствуя всем законам дядюшки Ньютона, а проседания FPS практически не наблюдалось, так как физика обрабатывалась с помощью технологии Project Flare.

А вот вторая техническая демка оказалась значительно веселее. На этот раз разработчики использовали для наглядной демонстрации игру Final Fantasy 11, в которую умудрились впихнуть режим "картинка в картинке", и теперь можно было наблюдать сразу за четырьмя персонажами в различных окошках выводимых на экран. Причём всё это производилось в режиме реального времени. Возможно Square Enix как бы намекнула, что их технология настолько хороша, что её можно было бы использовать даже в GTA 5. И ведь действительно, в GTA 5 можно было бы переключаться между персонажами в считанные мгновения, вне зависимости от того в каких Лос-Сантоса они находятся.

(, .)

Unreal Engine 4 Test

AMD TressFX 2.0

TressFX 2.0 Hair Demo. .

UDK - Realtime - AntarcticTime

Mantle Star Swarm Demo - Oxide Engine

PS: у меня одного грамматический диссонанс от названия темы? Устал натыкаться, исправьте на Техно-демо и графика в реальном времени

PS: у меня одного грамматический диссонанс от названия темы? Устал натыкаться, исправьте на Техно-демо и графика в реальном времени

Технологические демо = Техно-демо.

Да, согласен. Вторую часть лучше подправить.

Да, согласен. Вторую часть лучше подправить.

HairWorks — собственное решение nVidia для эмуляции волос и шерсти

Компания AMD сделала неплохой маркетинговый ход, представив свою технологию эмуляции волос и шерсти TressFX. Кроме того, компания пообещала выпустить новую, улучшенную версию этой технологии, и ответ nVidia не заставил себя долго ждать.

Конкурентная компания представила свою разработку под названием HairWorks, которая основана на общедоступном API DirectCompute. В видеоролике ниже показано, какова эта технология в реальности. Для примера была показана эмуляция шерсти животных в игре Call of Duty: Ghosts, которая называется Dynamic Fur, и надо отметить, что она весьма хороша.

Впервые технология реалистичного отображения шерсти появилась на E3 2013 для волка в игре Witcher 3, после чего она была улучшена во многих играх, включая тот же Witcher 3, Call of Duty: Ghosts и прочих. Каждый объект шерсти содержит от 400 до 500 тысяч отдельных волосков. Большинство из них создаются динамически на лету с помощью GPU на основе 10 тысяч опорных волос, которые эмулируются и создают основу для дальнейшей тесселяции.

TressFX 2.0

syndagent, PhysX =(

syndagent, PhysX =(

Вроде в физиксе нет модуля для волос

Цитата

Разработчики проявляют повышенный интерес к данной технологии, поэтому помимо Ведьмака 3, стоит ожидать и другие игры, использующие симуляцию волос и шерсти от NVIDIA.

Цитата

Стоит отметить, что в отличии от других физический решений NVIDIA с поддержкой аппаратного ускорения на GPU, HairWorks использует API DirectCompute, а значит, доступна и для владельцев видеокарточек от AMD.

Иными словами написано не с использованием CUDA,а на directcompute.

Но работать будет только на d3d тайлах.

Хотя возможно и портируют под compute шейдеры opengl >=4.4

Для просмотра полной версии этой страницы, пожалуйста, пройдите по ссылке.